LLMと生成AIアプリケーション用のフルスタックのオブザーバビリティ

AIとLLMスタックのコストを削減してパフォーマンスを向上

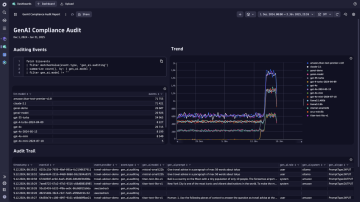

- 予防策を促進するように統合されたカスタマイズ可能なダッシュボードを使用して、トークンコスト、リクエスト期間、問題などの生成AIアプリケーションの運用メトリクスを監視

- Davis® AIの活用により、ユーザーの行動の変化を検出し、コスト増を予測し、先回りして管理コストを差異化

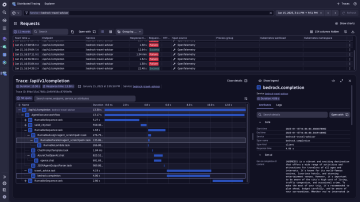

- 最も遅いリクエストやエラーのトレースを解析することで、モデルの応答時間を削減して信頼性を向上

- 事前定義済みのしきい値、予期しない動作、または想定パターンからの逸脱に基づいて、自動化されたワークフローをトリガー

AIを活用したアプリケーションの出力結果を説明し、そのプロセスを遡及して説明

- オーケストレーション、セマンティックキャッシュ、LLMモデルのレイヤーを含むアプリケーションスタック全体に対応するエンドツーエンドのトレースで、各ユーザーリクエストの実行について完全な可視性を獲得

- 複数のLLM、RAGパイプライン、エージェント型フレームワークにわたるシステム全体のエンドツーエンドのオブザーバビリティによって依存関係のトレースとマッピングを実施し、シームレスな統合と最適なユーザーエクスペリエンスを確実に実現

- Davis® AIを活用してLLMチェーンのエラーや失敗の根本原因を自動的に特定し、顧客に影響が及ぶ前に先回りして解決を推進

Dynatraceパートナーシッププログラムに参加する

AIソリューションを作成しているお客様は、ぜひ当社にご連絡いただき、AI Observability Readyパートナーの認証をお受けください。