Ao combinar nossas iniciativas de IA agêntica com os recursos de observabilidade de IA da Dynatrace, otimizamos nossos workflows de desenvolvimento e operações.

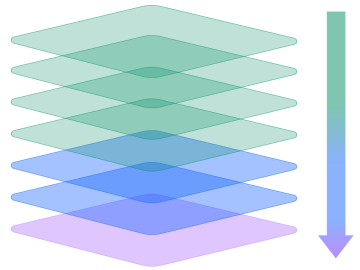

Integre e observe

Integre e observe cada camada da pilha de IA, de aplicações de usuário a LLMs e infraestrutura, com suporte nativo para as principais plataformas de IA.

Acompanhe como a IA cria ganhos de produtividade, evita tíquetes de suporte, age com autonomia e entrega retorno sobre o investimento.

Acompanhe a experiência do usuário final, a disponibilidade e confiabilidade de aplicações com IA.

Rastreie a performance da cadeia de operações, as proteções e o cache de prompts em estruturas de orquestração.

Observe protocolos, execução de comandos e uso de ferramentas pelos agentes, além da comunicação entre eles.

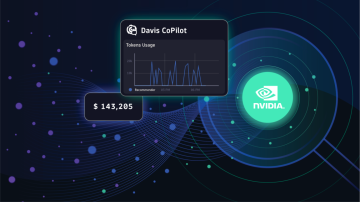

Avalie fatores como uso de tokens, custo, estabilidade, latência, erros de invocação e utilização de recursos na geração de resultados por modelos.

Monitore pipelines, volumes de dados, distribuição e padrões de recuperação de RAG.

Rastreie utilização, saturação e erros em GPUs, TPUs e recursos computacionais.

Uma cooperativa de serviços financeiros americana da Fortune 500 alcançou a observabilidade fim-a-fim em vários LLMs e aplicações em uma única plataforma, eliminando pontos cegos e reduzindo significativamente os custos.

Para conquistar a confiança dos clientes, estamos buscando a certificação ISO 42001. A observabilidade de IA da Dynatrace nos ajuda a cumprir muitos desses requisitos de controle devido aos insights que ela oferece sobre LLMs e seus comportamentos.

Observabilidade fim-a-fim para IA agêntica, IA generativa e LLMs

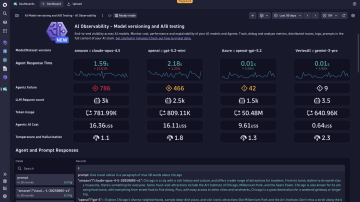

Reduza custos e aprimore a performance da pilha de IA agêntica e LLMs

- Monitore métricas operacionais de aplicações de IA generativa, como custo de tokens, duração das solicitações e problemas em dashboards unificados e personalizáveis que estimulam ações proativas

- Utilize a detecção inteligente para identificar alterações no comportamento dos usuários, prever aumentos de custo e fazer modificações proativas para gerenciar custos

- Reduza os tempos de resposta de agentes de IA e LLMs e melhore a confiabilidade analisando traces para detectar as solicitações mais lentas e os erros

- Compare a performance de modelos de IA diferentes com insights de testes A/B para tomar decisões embasadas sobre quais modelos implementar em produção

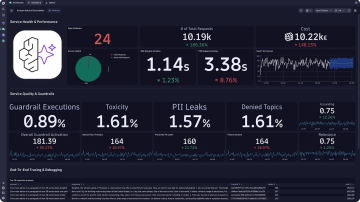

Desenvolva confiança e monitore proteções de entradas e saídas de LLMs

- Proteja a qualidade das aplicações de IA com monitoramento e análise de métricas de proteção para mitigar possíveis vieses, erros e uso indevido de sistemas de IA

- Reconheça alucinações de modelos, identifique tentativas de uso indevido de LLMs (como injeção de prompts maliciosos), evite

- vazamentos de informações de identificação pessoal (PII) e detecte linguagem tóxica Analise a eficácia das proteções de LLMs e faça os ajustes necessários para garantir a segurança e uma experiência ideal

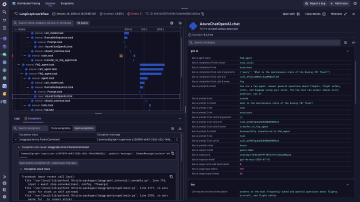

Explique, registre em log e rastreie saídas de serviços de IA

- Consiga visibilidade fim-a-fim na execução de cada solicitação de usuário com rastreamento e logs que abrangem toda a pilha de aplicações: front-end, back-end, orquestrações, RAG, LLM e camadas agênticas

- Registre em log, rastreie e mapeie dependências entre serviços em toda a arquitetura

- Detecção inteligente para identificar automaticamente a causa raiz de erros e falhas na cadeia de LLMs e agilizar proativamente a resolução antes que os clientes sejam afetados

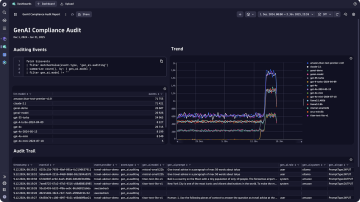

Reduza riscos de conformidade e proteja aplicações de GenAI

- Documente todas as entradas e saídas de forma abrangente e econômica, mantendo a linhagem completa dos dados, desde o prompt até a resposta, para criar uma trilha de auditoria clara e garantir a conformidade com padrões regulatórios

- Armazene até 10 anos de todos os seus prompts

- Desenvolva dashboards para visualizar o comportamento e a performance de sistemas de IA para aumentar a transparência das operações e comprovar a conformidade

- Promova iniciativas de redução de carbono com o monitoramento de dados de infraestrutura, incluindo temperatura, utilização de memória e uso de processos

Aprofunde-se nos detalhes

Participe do programa de parcerias da Dynatrace

Recursos

RelatórioO pulso da IA agêntica em 2026

RelatórioO pulso da IA agêntica em 2026 BlogA ascensão da IA agêntica, parte 7: apresentação da governança de dados e de trilhas de auditoria para serviços de IA

BlogA ascensão da IA agêntica, parte 7: apresentação da governança de dados e de trilhas de auditoria para serviços de IA BlogAWS publica o roteiro criado pela Dynatrace para acesso seguro ao Amazon Bedrock em grande escala

BlogAWS publica o roteiro criado pela Dynatrace para acesso seguro ao Amazon Bedrock em grande escala BlogAnúncio do Amazon Bedrock AgentCore Agent Observability

BlogAnúncio do Amazon Bedrock AgentCore Agent Observability BlogA NVIDIA Enterprise AI Factory aborda a rápida evolução das necessidades de infraestrutura de IA para apoiar o crescimento da IA agêntica.

BlogA NVIDIA Enterprise AI Factory aborda a rápida evolução das necessidades de infraestrutura de IA para apoiar o crescimento da IA agêntica. Otimização do ROI da IA aplicada a DevOps e operações de TI: a crescente necessidade de observabilidade de IA/LLMs

Otimização do ROI da IA aplicada a DevOps e operações de TI: a crescente necessidade de observabilidade de IA/LLMs