Dynatrace ci ha consentito di ridurre la risoluzione degli incidenti a pochi minuti, dal rilevamento fino alla pull request.

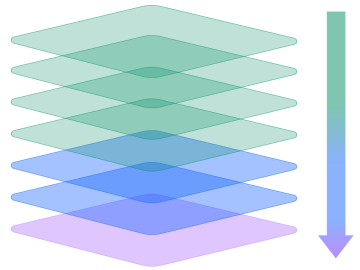

Integra e osserva

Integra e osserva ciascun livello dello stack IA, dalle applicazioni utente agli LLM fino all'infrastruttura, con supporto nativo per le principali piattaforme IA.

Monitora come l'IA favorisce una maggiore produttività, evita i ticket di assistenza, interviene in modo autonomo e genera ROI.

Traccia l'esperienza utente, la disponibilità e l'affidabilità delle applicazioni basate sull'IA.

Monitora le prestazioni della catena, i guardrail e il caching dei prompt tra framework di orchestrazione.

Osserva i protocolli per gli agenti, l'esecuzione dei comandi, l'utilizzo degli strumenti e le comunicazioni tra più agenti.

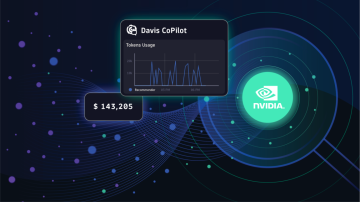

Valuta l'utilizzo dei token, i costi, la stabilità, la latenza, gli errori di invocazione e l'utilizzo delle risorse dei modelli di output.

Monitora le pipeline RAG, il volume dei dati, la distribuzione e gli schemi di recupero.

Monitora utilizzo, saturazione ed errori tra GPU, TPU e risorse di calcolo.

Una società americana di servizi finanziari Fortune 500 ha raggiunto un'osservabilità completa su più LLM e sulle applicazioni in un'unica piattaforma, eliminando i punti ciechi e ottenendo notevoli risparmi sui costi.

Per guadagnare la fiducia dei clienti stiamo ottenendo la certificazione ISO 42001. L'osservabilità per IA di Dynatrace ci consente di soddisfare molti dei requisiti di controllo richiesti grazie alle informazioni che fornisce sugli LLM e sul loro comportamento.

Osservabilità completa per IA agentica, IA generativa e LLM

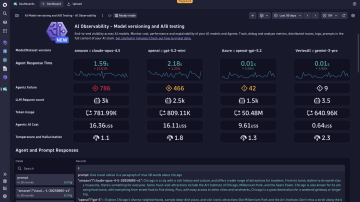

Riduci i costi e migliora le prestazioni dello stack agentico, IA e LLM

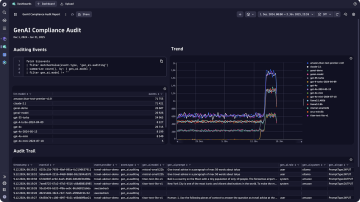

- Monitora le metriche operative delle applicazioni GenAI come il costo dei token, la durata delle richieste e i problemi, grazie a dashboard unificate e personalizzabili che permettono di agire in modo proattivo

- Sfrutta il rilevamento intelligente per identificare i cambiamenti nel comportamento degli utenti, prevedere aumenti dei costi e apportare modifiche in modo proattivo per tenere sotto controllo le spese

- Riduci i tempi di risposta di agenti IA e LLM e migliora l'affidabilità analizzando le trace delle richieste più lente e degli errori

- Confronta le prestazioni di diversi modelli IA con informazioni su test A/B per prendere decisioni informate sui modelli da distribuire in produzione

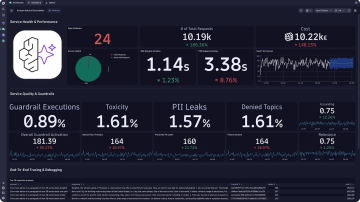

Crea fiducia, monitora i guardrail per input e output degli LLM

- Garantisci la qualità delle applicazioni IA monitorando e analizzando le metriche dei guardrail per mitigare potenziali bias, errori e usi impropri dei sistemi IA

- Riconosci le allucinazioni dei modelli, individua i tentativi di uso improprio degli LLM come l'injection di prompt dannosi

- Previeni la fuga di informazioni di identificazione personale e rileva linguaggio tossico Analizza l'efficacia dei guardrail per LLM e apporta le modifiche necessarie per garantire un'esperienza utente e una sicurezza ottimali

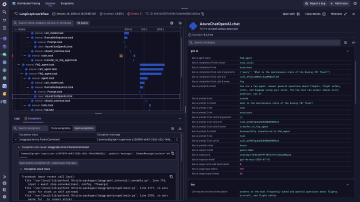

Spiega, registra e traccia gli output per servizi IA

- Ottieni una visibilità completa dell'esecuzione di ogni richiesta utente, con tracciamento, log per l'intero stack applicativo e a tutti i livelli: front-end, back-end, orchestrazioni, RAG, LLM e agentico

- Registra, traccia e mappa le dipendenze tra servizi in tutta architettura

- Utilizza il rilevamento intelligente per individuare automaticamente la causa principale di errori e guasti nella catena degli LLM e accelerare in modo proattivo la risoluzione prima che abbia ripercussioni sui clienti

Riduci il rischio di non conformità e proteggi le applicazioni di IA generativa

- Documenta in modo completo e conveniente tutti gli input e gli output, mantenendo il data lineage dal prompt alla risposta, per creare una chiara traccia di controllo che garantisca la conformità agli standard normativi

- Conserva tutti i prompt per un periodo fino a 10 anni

- Crea dashboard per visualizzare il comportamento e le prestazioni dei sistemi IA, al fine di renderne più trasparente il funzionamento e dimostrare la conformità

- Sostieni iniziative di riduzione delle emissioni di carbonio monitorando i dati dell'infrastruttura, tra cui temperatura, consumo di memoria e utilizzo dei processi

Entra nel programma di partnership di Dynatrace

Risorse

ReportLo stato dell'IA agentica nel 2026

ReportLo stato dell'IA agentica nel 2026 BlogL'ascesa dell'IA agentica, parte 7: governance dei dati e audit trail per i servizi IA

BlogL'ascesa dell'IA agentica, parte 7: governance dei dati e audit trail per i servizi IA BlogAWS pubblica il blueprint sviluppato da Dynatrace per l'accesso sicuro ad Amazon Bedrock su larga scala

BlogAWS pubblica il blueprint sviluppato da Dynatrace per l'accesso sicuro ad Amazon Bedrock su larga scala BlogAnnouncing Amazon Bedrock AgentCore Agent Observability

BlogAnnouncing Amazon Bedrock AgentCore Agent Observability BlogLa piattaforma NVIDIA Enterprise AI Factory è progettata per far fronte alle esigenze in continua evoluzione dell'infrastruttura IA, in risposta alla crescente affermazione dell'IA agentica.

BlogLa piattaforma NVIDIA Enterprise AI Factory è progettata per far fronte alle esigenze in continua evoluzione dell'infrastruttura IA, in risposta alla crescente affermazione dell'IA agentica. Ottimizzare il ROI dell'IA in ambito DevOps e IT operation: la crescente necessità di osservabilità per IA/LLM

Ottimizzare il ROI dell'IA in ambito DevOps e IT operation: la crescente necessità di osservabilità per IA/LLM