Al combinar nuestras iniciativas de IA de agentes con las capacidades de observabilidad de IA de Dynatrace, hemos logrado optimizar nuestros flujos de trabajo de desarrollo y operaciones.

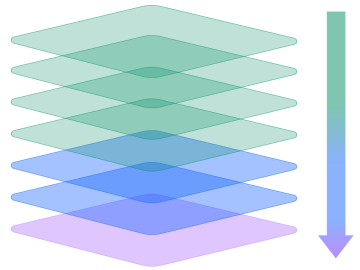

Integrar y observar

Integra y observa cada capa del stack de IA —desde las aplicaciones de usuario hasta los LLM y la infraestructura— con soporte nativo para las principales plataformas de IA.

Haz un seguimiento de cómo la IA genera ganancias de productividad, desvía incidencias de soporte, actúa de forma autónoma y ofrece retorno de la inversión.

Rastrea la experiencia de usuario final, la disponibilidad y la fiabilidad de las aplicaciones impulsadas por IA.

Realiza el seguimiento del rendimiento de las cadenas, las barreras de protección y el almacenamiento en caché de prompts en los marcos de orquestación.

Observa los protocolos de agentes, la ejecución de comandos, el uso de herramientas y las comunicaciones multiagente.

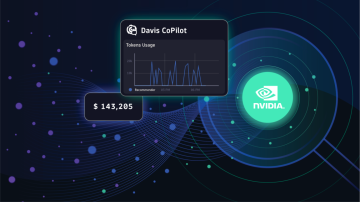

Evalúa el uso de tokens, el coste, la estabilidad, la latencia, los errores de invocación y la utilización de recursos de las salidas del modelo.

Supervisa canales de RAG, volumen de datos, distribución y patrones de recuperación.

Realiza el seguimiento de la utilización, la saturación y los errores en unidades GPU, TPU y recursos de computación.

Un fondo de inversiones estadounidense de la lista Fortune 500 que ofrece servicios financieros logró, en una única plataforma, la observabilidad end-to-end en varios LLM y en las aplicaciones que alimentan a estos, lo que permitió eliminar puntos ciegos e impulsar importantes ahorros en los costes.

Para ganar la confianza de nuestros clientes, buscamos la certificación ISO 42001. La observabilidad de IA de Dynatrace nos ayuda a cumplir muchos de esos requisitos de control gracias a la información que proporciona sobre los LLM y sus comportamientos.

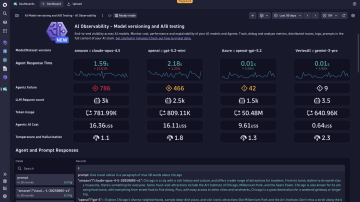

Observabilidad end-to-end para IA agéntica, IA generativa y LLM

Reduce el coste y mejora el rendimiento de tu stack de IA agéntica, IA y LLM

- Monitoriza métricas operativas de aplicaciones de IA generativa, como coste por token, duración de solicitudes y problemas, con dashboards unificados y personalizables que fomentan medidas proactivas

- Aprovecha la detección inteligente para identificar cambios en el comportamiento de los usuarios, prever aumentos de costes y hacer cambios proactivos para gestionar los costes

- Reduce los tiempos de respuesta de los agentes de IA y los LLM y mejora la fiabilidad analizando las trazas de las solicitudes más lentas y los errores

- Compara el rendimiento de distintos modelos de IA con información de pruebas A/B para tomar decisiones informadas sobre qué modelos desplegar en producción

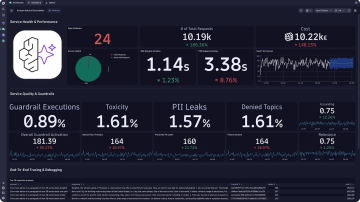

Genera confianza, monitoriza las barreras de protección de entrada y salida de LLM

- Protege la calidad de las aplicaciones de IA monitorizando y analizando métricas de control para mitigar posibles sesgos, errores y usos indebidos de los sistemas de IA.

- Detecta alucinaciones de los modelos, identifica intentos de uso indebido de LLM, como inyecciones maliciosas de prompts, evita

- la filtración de información personal y detecta lenguaje tóxico Analiza la eficacia de las barreras de protección de los LLM y realiza los ajustes necesarios para garantizar una experiencia de usuario óptima y segura

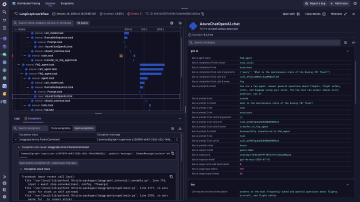

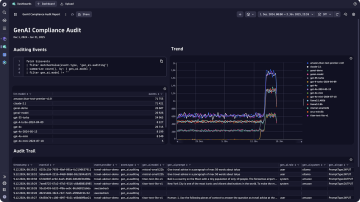

Explica, registra y rastrea los resultados de tus servicios de IA

- Obtén visibilidad end-to-end en la ejecución de cada solicitud de usuario, con trazas y logs que cubren todo el stack de aplicaciones: frontend, backend, orquestaciones, RAG, LLM y capas agénticas

- Registra, rastrea y mapea dependencias entre tus servicios, abarcando toda tu arquitectura

- Detección inteligente para identificar automáticamente la causa raíz de errores y fallos en la cadena de LLM y acelerar proactivamente su resolución antes de que afecten a los clientes

Reduce el riesgo de cumplimiento y protege tus aplicaciones de IA generativa

- Documenta de forma completa y rentable todas las entradas y salidas, y conserva el linaje íntegro de los datos desde el prompt hasta la respuesta para generar una trazabilidad clara que garantice el cumplimiento de los estándares normativos

- Almacena todos tus prompts hasta 10 años

- Crea dashboards para visualizar el comportamiento y rendimiento de los sistemas de IA, hacer más transparente su funcionamiento y demostrar su cumplimiento

- Apoya iniciativas de reducción de carbono monitorizando datos de infraestructura, como temperatura y uso de memoria y procesos

Profundiza en los detalles

Únete al programa de partners de Dynatrace

Recursos

InformeEl pulso de la IA agéntica en 2026

InformeEl pulso de la IA agéntica en 2026 BlogEl auge de la IA agéntica parte 7: introducción de la gobernanza de datos y de las trazas de auditoría para servicios de IA

BlogEl auge de la IA agéntica parte 7: introducción de la gobernanza de datos y de las trazas de auditoría para servicios de IA BlogAWS publica un plan desarrollado por Dynatrace para acceder de forma segura a Amazon Bedrock a escala

BlogAWS publica un plan desarrollado por Dynatrace para acceder de forma segura a Amazon Bedrock a escala BlogAnuncio de observabilidad de agentes en Amazon Bedrock AgentCore

BlogAnuncio de observabilidad de agentes en Amazon Bedrock AgentCore BlogNVIDIA Enterprise AI Factory aborda las necesidades en rápida evolución de infraestructura de IA para respaldar el auge de la IA agéntica.

BlogNVIDIA Enterprise AI Factory aborda las necesidades en rápida evolución de infraestructura de IA para respaldar el auge de la IA agéntica. Optimizar el ROI de la IA desde DevOps y operaciones de TI: la creciente necesidad de observabilidad de IA/LLM

Optimizar el ROI de la IA desde DevOps y operaciones de TI: la creciente necesidad de observabilidad de IA/LLM