Al combinar nuestras iniciativas de IA de agentes con las capacidades de observabilidad de IA de Dynatrace, hemos optimizado con éxito nuestros flujos de trabajo de desarrollo y operaciones.

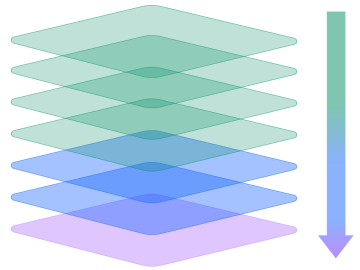

Integra y observa

Integra y observa cada capa de tu stack de IA —desde las aplicaciones de usuario hasta los LLM y la infraestructura— con soporte nativo para las principales plataformas de IA.

Sigue de cerca cómo la IA genera ganancias de productividad, reduce los tickets de soporte, actúa de forma autónoma y brinda retorno sobre la inversión.

Realiza el rastreo de la experiencia del usuario final, la disponibilidad y la confiabilidad de tus aplicaciones basadas en IA.

Monitorea el rendimiento de la cadena, las barreras de protección y el almacenamiento en caché de instrucciones en los marcos de orquestación.

Observa los protocolos de los agentes, la ejecución de comandos, el uso de herramientas y las comunicaciones multiagente.

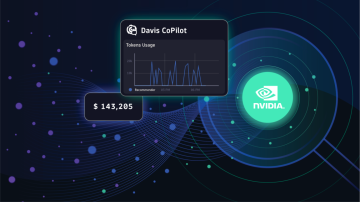

Evalúa el uso de tokens, costos, estabilidad, latencia, errores de invocación y utilización de recursos de las salidas del modelo.

Monitorea los canales de RAG, el volumen de datos, la distribución y los patrones de recuperación.

Monitoriza la utilización, la saturación y los errores en GPU, TPU y recursos de cómputo.

Una mutual de servicios financieros de Fortune 500 logró observabilidad de extremo a extremo en múltiples LLM y las aplicaciones que estos impulsan en una sola plataforma, eliminando puntos ciegos y generando ahorros significativos.

Para ganar la confianza de nuestros clientes, vamos a obtener la certificación ISO 42001. La observabilidad de IA de Dynatrace nos ayuda a cumplir con muchos de esos requisitos de control gracias a la visibilidad que ofrece sobre los LLM y sus comportamientos.

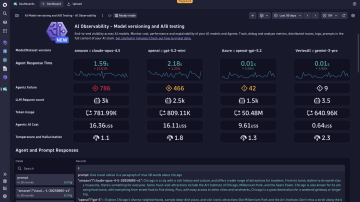

Observabilidad de extremo a extremo para IA de agentes, IA Generativa y LLM

Reduce costos y mejora el rendimiento de tu stack de IA, LLM y agentes.

- Monitorea las métricas operativas de las aplicaciones de IA generativa, como el costo de los tokens, la duración de las solicitudes y los problemas con los paneles de control unificados y personalizables que impulsan la acción proactiva.

- Aprovecha la detección inteligente para identificar cambios en el comportamiento de los usuarios, predecir aumentos de costos y realizar cambios de forma proactiva para gestionar los costos.

- Disminuye los tiempos de respuesta del agente de IA y del LLM, y mejora la confiabilidad analizando trazas en busca de las solicitudes más lentas y los errores.

- Compara el rendimiento de diferentes modelos de IA con información de pruebas A/B para tomar decisiones informadas sobre qué modelos desplegar en producción.

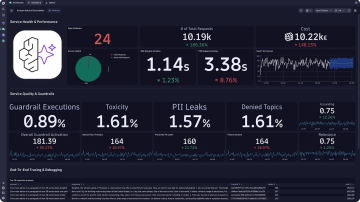

Genera confianza, monitorea las barreras de protección de entrada y salida de tus LLM.

- Protege la calidad de las aplicaciones de IA monitoreando y analizando las métricas de protección para mitigar los posibles sesgos, los errores y el uso indebido de los sistemas de IA.

- Reconoce las alucinaciones del modelo, identifica los intentos de uso indebido del LLM, como la inyección maliciosa de instrucciones, evita

- la fuga de Información de Identificación Personal (PII) y detecta lenguaje tóxico. Analiza la eficacia de las protecciones del LLM y haz los ajustes necesarios para garantizar una experiencia de usuario y seguridad óptimas.

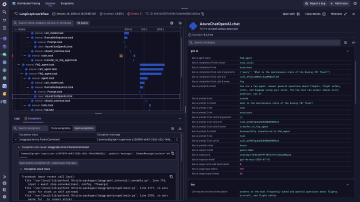

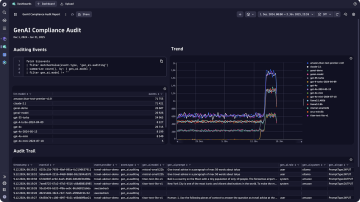

Explica, registra y rastrea el origen de los resultados de tus servicios de IA

- Consigue visibilidad de extremo a extremo en la ejecución de cada petición de usuario, con trazas y logs que cubren todo el stack de la aplicación: frontend, backend, orquestación, RAG, LLM y capas de agente

- Genera logs, rastrea y mapea las dependencias entre tus servicios a lo largo de toda tu arquitectura

- Detección inteligente para localizar automáticamente la causa raíz de los errores y fallas en la cadena del LLM y acelerar la resolución de manera proactiva, antes de que afecte a los clientes

Reduce el riesgo de cumplimiento y protege tus aplicaciones de GenAI

- Documenta de forma exhaustiva y rentable todas las entradas y salidas, manteniendo una línea de datos completa desde la solicitud hasta la respuesta para crear una pista de auditoría clara que garantice el cumplimiento de las normas reglamentarias.

- Almacena todas tus instrucciones durante un máximo de 10 años

- Desarrolla paneles de control para visualizar el comportamiento y el rendimiento de los sistemas de IA para que su funcionamiento sea más transparente y demostrar el cumplimiento de las normas.

- Respalda las iniciativas de reducción de emisiones de carbono mediante el monitoreo de los datos de infraestructura, incluidos la temperatura, la utilización de la memoria y el uso del proceso

Conoce todos los detalles

Únete al programa de partners de Dynatrace

Recursos

InformeEl pulso de la IA de agentes en 2026

InformeEl pulso de la IA de agentes en 2026 BlogEl auge de la IA de agentes, parte 7: Introducción a la gobernanza de datos y pistas de auditoría para servicios de IA

BlogEl auge de la IA de agentes, parte 7: Introducción a la gobernanza de datos y pistas de auditoría para servicios de IA BlogAWS publica el modelo de arquitectura desarrollado por Dynatrace para el acceso seguro a Amazon Bedrock a escala

BlogAWS publica el modelo de arquitectura desarrollado por Dynatrace para el acceso seguro a Amazon Bedrock a escala BlogAnnouncing Amazon Bedrock AgentCore Agent Observability

BlogAnnouncing Amazon Bedrock AgentCore Agent Observability BlogNVIDIA Enterprise AI Factory aborda las necesidades en constante evolución de la infraestructura de IA para dar soporte al auge de la IA de agentes.

BlogNVIDIA Enterprise AI Factory aborda las necesidades en constante evolución de la infraestructura de IA para dar soporte al auge de la IA de agentes. Optimizar el ROI de la IA en DevOps y operaciones de TI: La creciente necesidad de observabilidad de IA/LLM

Optimizar el ROI de la IA en DevOps y operaciones de TI: La creciente necesidad de observabilidad de IA/LLM