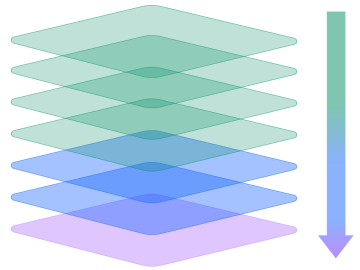

Integrieren und beobachten

Integrieren und überwachen Sie jede AI-Stack-Ebene – von Benutzeranwendungen bis hin zu LLMs und Infrastruktur – mit nativer Unterstützung für führende KI-Plattformen.

Verfolgen Sie, wie KI Produktivitätssteigerungen erzielt, Support-Anfragen reduziert, autonom agiert und eine Rendite erzielt.

Verfolgen Sie die Endbenutzererfahrung, Verfügbarkeit und Zuverlässigkeit von KI-gestützten Anwendungen.

Überwachen Sie Chain-Performance, Sicherheitsvorrichtungen und sofortiges Caching über Orchestrierungs-Frameworks hinweg.

Beobachten Sie die Protokolle der Agenten, die Ausführung von Befehlen, die Verwendung von Tools sowie die Kommunikation zwischen mehreren Agenten.

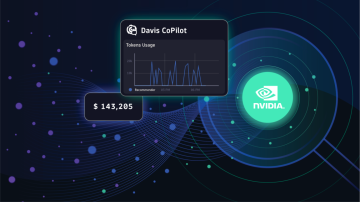

Bewerten Sie die Token-Nutzung, Kosten, Stabilität, Latenz, Aufruffehler und Ressourcenauslastung der Modellergebnisse.

Überwachen Sie RAG-Pipelines, Datenvolumen, Verteilung und Abrufmuster.

Verfolgen Sie Auslastung, Sättigung und Fehler von GPUs, TPUs und Rechenressourcen.

Ein amerikanisches Finanzdienstleistungsunternehmen aus dem Fortune-500-Index hat mit einer einzigen Plattform eine durchgängige Observability über mehrere LLMs und die von ihnen betriebenen Anwendungen hinweg erreicht und damit Schwachstellen beseitigt und erhebliche Kosteneinsparungen erzielt.

Durchgängige Observability für agentenbasierte KI, generative KI und LLMs

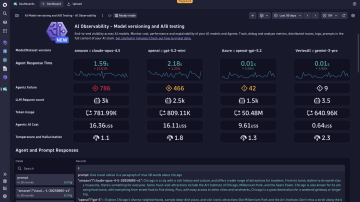

Reduzieren Sie die Kosten und verbessern Sie die Leistung Ihres agentenbasierten, KI- und LLM-Stacks

- Überwachen Sie operative Kennzahlen für GenAI-Anwendungen wie Token-Kosten, Anfragedauer und Probleme mit einheitlichen und anpassbaren Dashboards, die proaktive Maßnahmen ermöglichen

- Nutzen Sie intelligente Erkennungsfunktionen, um Veränderungen im Benutzerverhalten zu identifizieren, Kostensteigerungen vorherzusagen und proaktiv Änderungen zur Kostenkontrolle vorzunehmen

- Reduzieren Sie die Antwortzeiten von KI-Agenten und LLM und verbessern Sie die Zuverlässigkeit, indem Sie die Spuren der langsamsten Anfragen und Fehler analysieren

- Vergleichen Sie die Leistung verschiedener KI-Modelle anhand von A/B-Test-Ergebnissen, um fundierte Entscheidungen darüber zu treffen, welche Modelle in der Produktion eingesetzt werden sollen

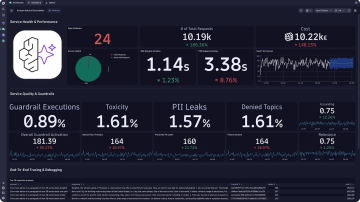

Vertrauen aufbauen, Sicherheitsvorrichtungen für LLM-Eingaben und Ergebnisse überwachen

- Sichern Sie die Qualität von KI-Anwendungen durch Monitoring und Analyse von Guardrail-Kennzahlen, um potenzielle Verzerrungen, Fehler und Missbrauch von KI-Systemen zu minimieren

- Erkennen Sie Modellhalluzinationen, identifizieren Sie LLM-Missbrauchsversuche, wie z. B. böswillige Prompt-Injektionen, und verhindern Sie diese

- Verlust personenbezogener Daten (PII) und Erkennung toxischer Sprache Analyse der Wirksamkeit von LLM-Sicherheitsvorkehrungen und Durchführung notwendiger Anpassungen, um eine optimale Benutzererfahrung und Sicherheit zu gewährleisten

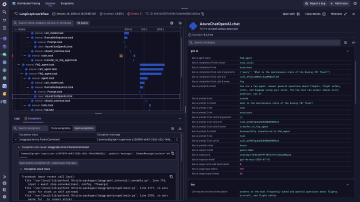

Erläutern, protokollieren und verfolgen Sie die Ergebnisse Ihres KI-Dienstes

- Erhalten Sie umfassende Transparenz über die Ausführung jeder Benutzeranfrage mit Tracing und Protokollen, die den gesamten Anwendungsstack abdecken: Frontend, Backend, Orchestrierungen, RAG, LLM und Agentenschichten

- Protokollieren, verfolgen und ordnen Sie Abhängigkeiten zwischen Ihren Diensten, die sich über Ihre gesamte Architektur erstrecken

- Intelligente Erkennung, um die Ursache von Fehlern und Ausfällen in der LLM-Kette automatisch zu lokalisieren und die Behebung proaktiv zu beschleunigen, bevor Kunden davon betroffen sind

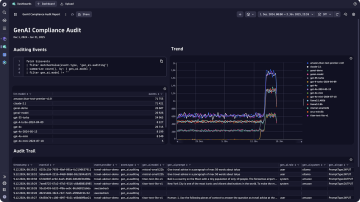

Reduzieren Sie Compliance-Risiken und sichern Sie Ihre GenAI-Anwendungen

- Dokumentieren Sie alle Eingaben und Ausgaben umfassend und kosteneffizient und bewahren Sie dabei die vollständige Datenherkunft von der Eingabe bis zur Antwort auf, um einen klaren Prüfpfad zu erstellen und die Einhaltung gesetzlicher Vorschriften sicherzustellen

- Speichern Sie alle Ihre Eingabeaufforderungen für bis zu 10 Jahre

- Erstellen Sie Dashboards, um das Verhalten und die Leistung von KI-Systemen zu visualisieren, ihren Betrieb transparenter zu gestalten und die Einhaltung von Vorschriften nachzuweisen

- Unterstützen Sie Initiativen zur Reduzierung des CO₂-Ausstoßes, indem Sie Infrastrukturdaten wie Temperatur, Speicherauslastung und Prozessnutzung überwachen

Stets bestens informiert

Werden Sie Teil des Dynatrace-Partnerprogramms

Ressourcen

ReportDer Puls der agentenbasierten KI im Jahr 2026

ReportDer Puls der agentenbasierten KI im Jahr 2026 BlogDer Aufstieg der agentenbasierten KI, Teil 7: Einführung von Daten-Governance und Prüfpfaden für KI-Dienste

BlogDer Aufstieg der agentenbasierten KI, Teil 7: Einführung von Daten-Governance und Prüfpfaden für KI-Dienste BlogAWS veröffentlicht den von Dynatrace entwickelten Entwurf für sicheren Amazon Bedrock-Zugriff in großem Maßstab

BlogAWS veröffentlicht den von Dynatrace entwickelten Entwurf für sicheren Amazon Bedrock-Zugriff in großem Maßstab BlogWir stellen vor: Amazon Bedrock AgentCore-Agenten-Observability

BlogWir stellen vor: Amazon Bedrock AgentCore-Agenten-Observability BlogDie NVIDIA Enterprise AI Factory befasst sich mit den sich rasch entwickelnden Anforderungen an die KI-Infrastruktur, um den Aufstieg der agentenbasierten KI zu unterstützen.

BlogDie NVIDIA Enterprise AI Factory befasst sich mit den sich rasch entwickelnden Anforderungen an die KI-Infrastruktur, um den Aufstieg der agentenbasierten KI zu unterstützen. Optimierung des KI-ROI aus DevOps und IT-Betrieb: Der steigende Bedarf an KI/LLM-Observability

Optimierung des KI-ROI aus DevOps und IT-Betrieb: Der steigende Bedarf an KI/LLM-Observability